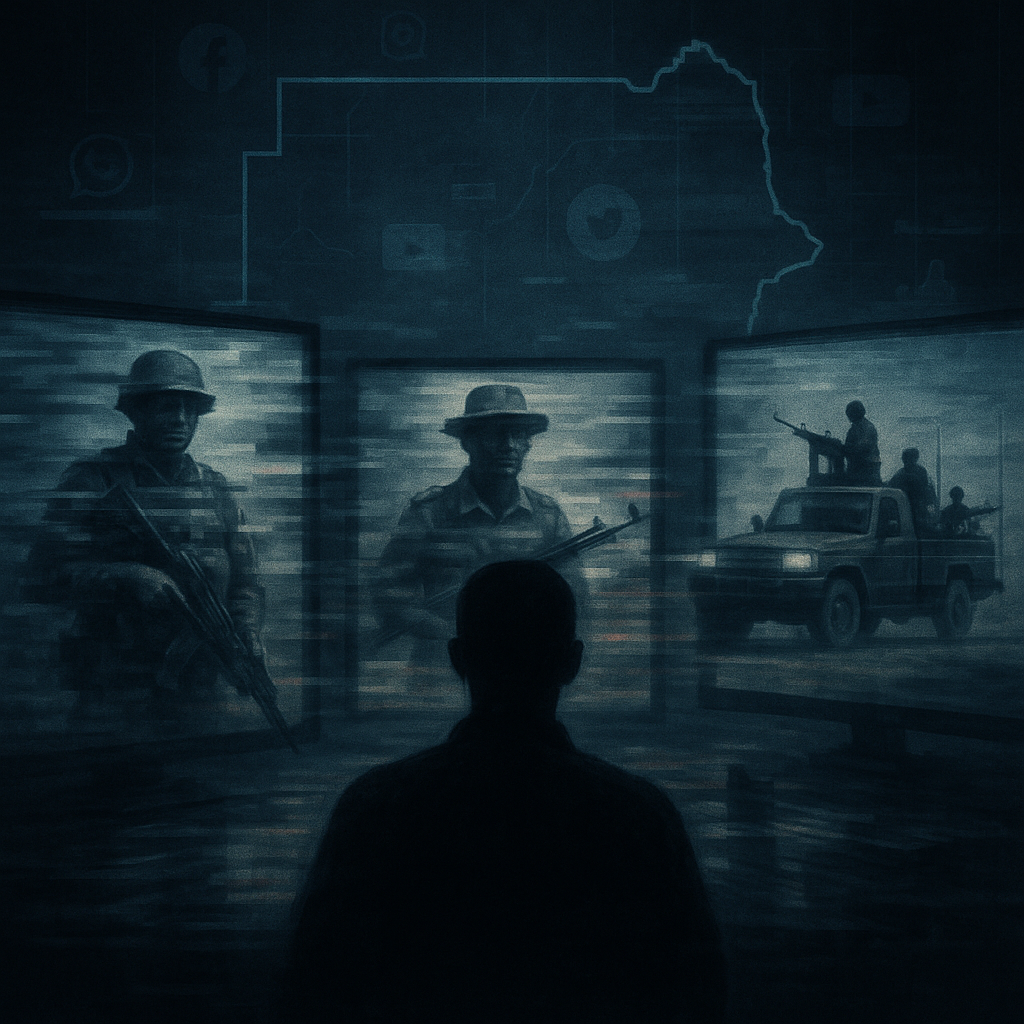

يبدو أن مخاطر التزييف العميق بالذكاء الاصطناعي في السودان مدفوعة حاليًا بدرجة أكبر بنقاط الضعف في جانب الطلب، وليس بحجم انتشار محتوى التزييف العميق نفسه. فبينما لا يزال انتشار المعلومات المضللة المُولَّدة بالذكاء الاصطناعي في المنصات السودانية محدودًا، فإن تصوّر وجود تزييفات عميقة (مزعومة) بالذكاء الاصطناعي، إلى جانب الشك العام تجاه هذه التقنيات، يزيد من تفاقم الوضع ويسهم في حالة عامة من عدم اليقين تجاه المحتوى متعدد الوسائط.

ضمن الحالات التي جرى تحليلها، تبيّن أن الموقف السائد هو عدم الثقة، وهو موقف نابع بدرجة أكبر من الاستدلال المدفوع بالمعتقدات والاعتماد على السياق، وليس من امتلاك مهارات راسخة لاكتشاف التزييف بالذكاء الاصطناعي. عمليًا، فإن رفض أو قبول محتوى يُشتبه بأنه تزييف عميق يعكس في الغالب أحكامًا قائمة على القناعات المسبقة أكثر من كونه تقييمًا تقنيًا.

هذه الدفاعات الضعيفة تترك بيئة المعلومات عرضة لحملات تزييف عميق أكثر تطورًا في المستقبل، كما تنطوي على خطر تطبيع اللامبالاة تجاه الحقيقة. وعلى المدى القصير، ينبغي أن تركز التدخلات على إجراءات عامة غير مرتبطة بنوع الوسيط، تستهدف جانب الطلب، مثل التحصين المسبق (pre-bunking)، وتعزيز الثقافة الرقمية والوعي بالذكاء الاصطناعي، وتوسيع نطاق التحقق من الحقائق، وإنشاء خطوط إبلاغ، بما يعزز قدرة الجمهور على الصمود في مواجهة مختلف أشكال التضليل. أما التدخلات التقنية المتخصصة بالذكاء الاصطناعي، وتلك التي تستهدف جانب العرض، فيمكن تطويرها لاحقًا مع توفر القدرات المؤسسية والتكنولوجية اللازمة.